Les intelligences artificielles progressent à une vitesse incroyable. OpenAI a développé Generative Pre-trained Transformer-2 (GPT-2), un robot intelligent capable d’écrire, mieux que les humains à tel point que les concepteurs ont décidé qu’il était dangereux.

L’association OpenAI a posé des limites, elle a abandonné l’idée que le code open source de l’intelligence artificielle soit mis à la disposition de tous de peur qu’il tombe en de mauvaises mains.

Le générateur de texte OpenAI fait froid dans le dos

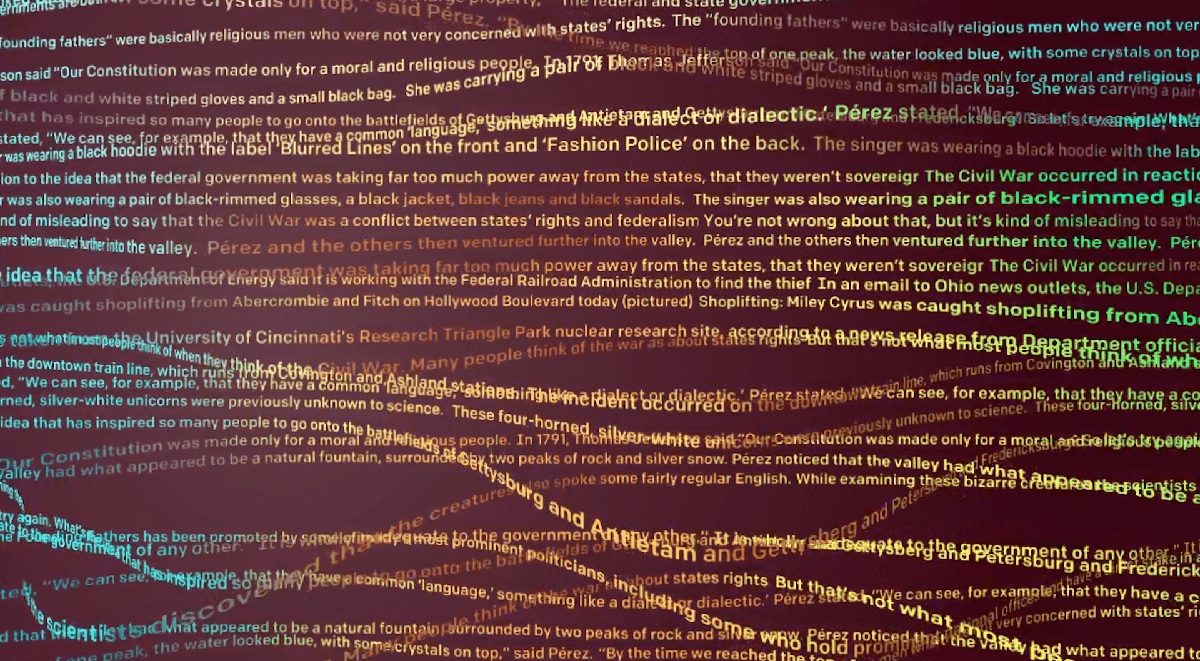

« Nous avons entraîné un modèle de langage qui peut générer des paragraphes cohérents et peut, de manière rudimentaire, réussir à comprendre les écrits, les traduire, répondre aux questions posées et résumer efficacement — tout ça sans entraînement spécifique » explique OpenAi.

GPT-2 s’est nourri pour cela de 8 millions de pages web et de 1,5 milliard de paramètres.

Ils précisent : « Etant donné que nous avons des réserves sur de potentielles utilisations malveillantes de notre technologie, nous ne diffuserons pas ce modèle. Nous allons à l’inverse, dans une démarche expérimentale de diffusion responsable, publier un modèle bien plus circonscrit, pour que des développeurs puissent l’expérimenter.»

Autrement dit, GPT-2 est capable d’adapter son style au contexte et à la finalité du texte en gardant sa propre identité ou en utilisant celle d’autrui. Texte d’auteurs de livres, articles journalistiques cette grosse bêbête informatique est capable de tout !

Pourquoi dangereux ?

A l’heure des fake news, du harcèlement sur le net et des problématiques sur les droits d’auteur sur Internet, GPT-2 le robot de OpenAI pourrait être détourné. Il pourrait par exemple écrire des articles relayant de fausses informations, automatiser la production de contenu abusif ou falsifié pour publier sur les médias sociaux, surproduire des contenus spam / phishing, contacter des gens via messagerie, prendre l’identité d’autrui… pour peu que le code tombe entre de mauvaises mains.

Et OpenAi de préciser : « bien que nous ne soyons pas sûrs que ce soit la bonne décision à prendre aujourd’hui, nous pensons que la communauté de l’IA devra à l’avenir s’attaquer de manière réfléchie à la question des normes de publication »

Les intelligences artificielles sont aujourd’hui un sujet sensible.

De plus en plus intelligentes, elles commencent même à inquiéter ceux qui travaillent dessus depuis des années, comme Google qui a récemment décidé de ne plus mettre à disposition ses codes sources aux développeurs, sans qu’on sache vraiment au fond, ce qu’ils en font.

Lire d’autres articles sur le thème des intelligences artificielles

We’ve trained an unsupervised language model that can generate coherent paragraphs and perform rudimentary reading comprehension, machine translation, question answering, and summarization — all without task-specific training: https://t.co/sY30aQM7hU pic.twitter.com/360bGgoea3

— OpenAI (@OpenAI) February 14, 2019